OpenAI高层“宫斗剧”的戏剧性转折,不仅吸引了全球科技界的目光,更暴露了人工智能领域在监管与治理上的深层隐忧。这场风波远非简单的权力斗争,而是折射出人工智能技术快速发展与其治理框架滞后之间的尖锐矛盾。尤其在人工智能应用软件开发领域,这一矛盾显得尤为突出。

OpenAI事件凸显了人工智能企业治理结构的不成熟。作为一家兼具科研使命与商业野心的机构,OpenAI在决策机制、权力制衡与透明度方面的缺失,导致其在关键发展方向上出现剧烈摇摆。这种内部治理的混乱,直接影响到其软件开发的方向与伦理准则的落实。例如,在是否放缓某项高风险AI功能发布、或如何平衡开源与闭源策略等重大决策上,缺乏稳定、透明的治理框架,使得软件开发可能偏离安全与可控的轨道。

这一事件暴露出当前人工智能监管的全球性漏洞。各国监管机构在应对AI技术爆炸式增长时,往往显得力不从心。监管法规的滞后、标准的不统一以及跨境协调的困难,使得像OpenAI这样的行业巨头在软件开发中可能游走于灰色地带。例如,在数据隐私、算法偏见、内容生成伦理等方面,缺乏具有强制力的国际标准与有效监督,导致开发者在追求技术突破时,可能忽视或弱化潜在的社会风险。

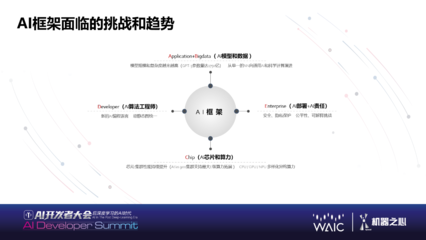

具体到人工智能应用软件开发,监管漏洞带来多重挑战。一是技术路线的不可预测性。企业内部动荡可能导致项目方向突变,影响软件生态的稳定性与连续性。二是安全与伦理风险加剧。在竞争压力下,开发团队可能为抢占市场而压缩安全测试与伦理评估环节,增加技术滥用风险。三是开源与闭源的博弈。治理失序可能影响开源策略,阻碍技术共享与协同创新,或相反,导致核心技术过早开放引发安全隐患。

为应对这些挑战,需从多层面构建稳健的人工智能治理与监管体系。企业层面,应建立权责清晰、透明合规的治理结构,将伦理审查嵌入软件开发全生命周期。行业层面,需推动形成自律标准与最佳实践,特别是在数据使用、模型透明度与问责机制上。政府与国际组织层面,应加快立法进程,建立跨域监管合作,对高风险AI应用实施许可或备案制,确保技术创新与公共利益平衡。

OpenAI的“宫斗剧”是一面镜子,映照出人工智能时代我们共同面临的治理考题。唯有通过健全的监管、透明的治理与负责任的开发,我们才能驾驭AI技术的巨浪,确保其软件开发真正服务于人类社会的可持续进步。